専門家が警告:この「5つの情報」をChatGPTに絶対に伝えないで! 一言で財産とキャリアを失う可能性とは

『ニューヨーク・ポスト』は特定の情報をチャットボットと共有してはいけないと大衆に注意を促している。(写真/AP)

現代人の生活のあらゆる側面でAIチャットボットが頼りにされている。感情相談からメールの作成、さらにはペット写真を人間の姿に変えることまで、これらのAIプラットフォームはまさに私たちのデジタル生活のパートナーとなっている。しかし、これは多くの個人情報を無意識のうちに入力していることも意味している。この傾向に対して、『ニューヨーク・ポスト』は特定の情報をチャットボットと共有してはならないと注意を促している。

「一度入力すれば、所有権を失う」:AIプライバシーリスクの解明

スタンフォード大学の人間中心AI研究所の研究員、ジェニファー・キング(Jennifer King)は、『ウォール・ストリート・ジャーナル』に対し「何かをチャットボットに入力すると、それに対する所有権を失う」と指摘。この問題の核心は、チャットボットに入力した内容がもう完全に自身のものではなくなる可能性にある。

多くのAI開発者も警告を発している。OpenAIは公式サイトで「会話中に敏感な情報を共有しないでください」と明示。GoogleもGeminiユーザーに対し「...機密情報やレビュアーに見られたくないデータは入力しないように」と促している。

では、ChatGPTや他のAIチャットボットに共有を避けるべき情報とは何か。『ニューヨーク・ポスト』は以下の5つをまとめた:

1. 身元確認情報: 社会保障番号、運転免許証やパスポート番号、誕生日、住所、電話番号など、身元を特定できる情報は絶対にAIチャットボットに開示してはならない。いくつかのチャットボットはこの種の情報に対してレッドアクトする(修正処理)と主張しているが、情報を根本的に共有しないのが最も安全である。OpenAIの広報担当者は『ウォール・ストリート・ジャーナル』に対し「私たちのAIモデルは世界を学習すべきであって個人のプライバシーではない。そのため、個人情報の収集を最小限に抑えるよう努めている」と述べた。

2. 医療結果: 医療業界は患者情報を厳しく守秘義務で保護しているが、AIチャットボットはこうした特別な保護には適用されない。AIに実験室の報告やその他の医療結果を解釈させたい場合、キング(King)は「テスト結果」の部分のみを残して、アップロード前にファイルを裁断や編集し、他の個人健康情報が漏れないようにすることを勧めている。

4. ログイン情報: AIエージェントの能力が日々強化され、アカウントのユーザー名やパスワードを提供してタスクを手伝ってもらいたくなるかもしれないが、これらのAIエージェントは金庫ではなく、アカウント情報の安全を保証できない。ログイン情報は専門のパスワード管理ツールに保存する方が賢明かつ安全な選択である。

5. 専有事業情報: ChatGPTなどのチャットボットを仕事で使用する場合(メールの草稿作成や文書編集など)、顧客データや未公開の企業秘密が偶発的に漏洩する可能性がある。『ウォール・ストリート・ジャーナル』は、このために一部の企業が企業版AIサービスを契約するか、カスタマイズされたAIプログラムを開発していると指摘している。これらのソリューションは通常、情報漏洩を防ぐための特別な保護策を講じている。

デジタルプライバシーを守る:AIとのインタラクションの賢い方法

これらの警告が重く感じられるかもしれないが、それでもAIチャットボットと個別の対話を楽しみたい場合、プライバシーを保護する方法がある。『ウォール・ストリート・ジャーナル』は、アカウントに強力なパスワードを使用し、多要素認証を有効にすることを推奨している。さらに、Anthropicのチーフインフォメーションセキュリティオフィサーであるジェイソン・クリントン(Jason Clinton)は、プライバシーを重視するユーザーには、各対話終了後直ちにすべての対話履歴を削除することを勧めており、企業は通常30日後に「削除済み」データを永久に削除していると述べている。

AIチャットボットの利便性を享受する一方で、個人の敏感情報を慎重に扱い、デジタル生活におけるプライバシーと安全を真に確保するために常に警戒を怠らないようにすることが重要である。

更多新聞請搜尋🔍風傳媒日文版

最新ニュース

台湾株、トランプ関税で夜間に180ポイント急落 非農業統計控え市場に緊張走る台湾株式市場は8月1日、ドナルド・トランプ米大統領が発表した新たな関税方針の影響を受けて大きく下落した。加権指数(加重平均指数)は108.14ポイント(0.46%)安の23,434.38ポイントで取引を終え、外国人投資家など三大法人による売越額は59億800万台湾ドル(約296億円)に達した。台湾先物市場では、夜間取引でさらに売りが加速。記者発稿時点で180......

台湾・台中と兵庫・尼崎が「スマート都市」で意気投合 デジタル×脱炭素で国境越えた交流へ台湾・台中市の林谷隆デジタル発展局長は、関西地方を訪問中の一環として、7月31日に兵庫県尼崎市を訪れ、松本眞市長を表敬訪問した。両市は、都市のデジタル化やゼロカーボンに向けたポイント制度の導入などについて、意見交換を行い、今後の協力深化を目指す考えを示した。尼崎市の松本市長は、現在同市がデジタル市民プラットフォームの整備を進めていることを紹介し、「台中市の取......

8月8日は「ポテコなげわの日」!池袋で限定イベント&お菓子プレゼントも株式会社東ハト(本社:東京都豊島区、代表取締役社長:滝沢康郎)は、8月8日の「ポテコなげわの日」を記念して、2025年8月8日(金)に池袋・サンシャインシティ噴水広場(専門店街アルパB1)にて、「ポテコなげわ縁日」と題した記念イベントを開催すると発表した。輪投げやストップウォッチチャレンジ、参加でお菓子プレゼント当日は、輪投げや射的、8.8秒でストップウォッ......

裏金17億円、40年続いた潜水艦修理めぐる不正の実態 防衛省が海自93人を一斉処分防衛省は7月30日、海上自衛隊の潜水艦修理契約に絡む一連の不正行為について、特別防衛監察の最終報告書を公表し、関係した自衛官93人に対する処分を発表した。処分対象には、現職の海上幕僚長である斎藤聡海将も含まれており、「指揮監督義務違反」により減給1か月(俸給の10分の1)の懲戒処分となった。特別防衛監察の最終報告を公表問題の発端は、大阪国税局の税務調査により......

中国軍、忠誠は共産党でなく習近平? 青学大・林教授が指摘する「制度なき統制」の危うさ青山学院大学の林載桓(イム・ジェファン)教授は2025年7月22日、日本記者クラブ主催の講演シリーズ「中国で何が起きているのか」第27回に登壇し、「習近平の終わりなき軍事改革と軍統制の個人化」と題した講演を行った。林氏は、中国の習近平国家主席が主導する軍改革について、「作戦能力は一定程度向上したが、共産党による制度的な統制はむしろ後退し、個人による支配が進ん......

「災害対応にジェンダーの視点が不可欠」 女性自衛官らが語る現場の変化と課題防衛省は7月31日、「女性・平和・安全保障(WPS)」に関するシンポジウムをハイブリッド形式で開催し、防災・災害対応分野におけるWPSの国内外の取り組みについて、関係省庁や関係機関の担当者が実例を交えて発表した。冒頭、防衛省の廣瀬政策立案総括審議官は「災害時においては、特に脆弱な立場にある人々のニーズに応じた支援が求められる」と述べたうえで、「女性や子ども、......

吳典蓉コラム:「民意」を読み違えた頼清徳総統 大規模リコールで露呈したリーダーの孤立7月26日、台湾で行われた大規模リコールは、もともと一種の賭けだった。頼清徳総統がこの勝負に出た理由は、資金を必要としない「元手のいらない事業」だからだ。一つには、これは他人の地で行われる戦争であり、もし敗北しても「市民団体」が盾となるからである。しかし、結果は25対0。民進党政権には大きな衝撃となり、負けず嫌いの挑戦者である頼氏は、さらに全党を挙げて8月2......

台湾と中国、異例の非公式交渉 頼政権の「オリーブの枝」を北京が一蹴台湾・民進党政権の高官である副総統・蕭美琴氏と、陸委会副主任の梁文傑氏は、それぞれ両岸関係の緩和を目指す「オリーブの枝」を差し出した。蕭氏は「現状維持」を掲げ、梁氏は「台湾にとって中国人であるか否かは問題ではない」と発言した。しかし、中国大陸の国台弁は30日の定例会見でこれらの呼びかけを一蹴し、事実上の「遠隔交渉」が行われる異例の形となった。頼清徳総統は先に......

親中路線を強めるトランプ氏 頼清徳総統を冷遇か?米中「取引外交」に警鐘米ジョンズ・ホプキンス大学高等国際関係学部のホワイト教授は30日、『ブルームバーグ』への寄稿で、トランプ大統領の対中姿勢に警鐘を鳴らした。ホワイト氏は、米国内では超党派で中国を最も危険な競争相手とする認識が広がっているものの、トランプ氏はその共通理解を崩しかねないと指摘。習近平氏への譲歩と頼清徳総統への冷遇という「取引主義」が、米台関係を明らかに損ねていると......

舞台裏》台湾リコールで中国も誤算 最も懸念していた人物とは?台湾全土で1年にわたって続いた大規模リコール運動は、7月26日に第1波の投票を終えた。結果は衝撃的で、国民党の立法委員24人と新竹市長の高虹安氏を含む計25人の国民党および民衆党の政治家がリコールされた。最終的に、国民党と民衆党の連合陣営は民進党と市民団体を圧倒し、士気を大きく高める一方、民進党と市民団体は内部対立に発展した。この大規模リコールの発起人である......

FRB分裂、利下げ巡り異例の反対票 31年ぶりの波乱で市場動揺米連邦準備制度理事会(FRB)は、日本時間の31日午前3時に最新の政策金利を発表した。市場予想通り、5回連続で据え置きとなり、フェデラルファンド(FF)金利は年4.25〜4.50%に維持された。しかし今回の決定では、理事のウォラー氏とボーマン氏が利下げを主張し、反対票を投じた。理事2名が同時に反対したのは1993年12月以来で、259回連続の会合で初めての事......

台湾関税は20%に決定 なぜ「最良税率」が日韓より高いのか、その背景とは米国のドナルド・トランプ大統領は7月31日、大統領令に署名し、8月1日から各国に対して新たな「相互関税(Reciprocal Tariffs)」を適用すると正式発表した。台湾の関税率は20%に設定され、4月に予告された32%からは引き下げられたものの、日本や韓国が合意した15%を上回り、国内外で注目を集めている。台湾は外交交渉を選択 副院長が訪米して減税を要......

20%関税で台湾株1.2兆台湾ドル蒸発 国家安定基金が緊急介入アメリカのトランプ大統領は8月1日、最新の「相互関税」リストを発表し、台湾に対して20%の関税率を適用することを明確に示した。これは日本および韓国の15%を上回り、インド、ベトナム、スリランカなどと同水準である。この発表を受け、台湾株式市場は本日、23,318.37ポイントで取引を開始し、前日比224.15ポイント安となった。取引中には一時23,168ポイン......

台湾株先物が急落500ポイント超 トランプ20%関税で市場に警戒感トランプ米大統領が最新の関税措置を発表、台湾は20%で日本・韓国の15%を上回る2025年8月1日、台湾株先物(台指期)は寄り付きで500ポイント超の急落となり、2万3000ポイントの大台をなんとか維持した。これは、トランプ米大統領が新たな関税措置を発表したことを受けた動きで、きょうの台湾株現物市場も失望売りに直面する可能性がある。トランプ大統領は前日、複数......

「テクノロジー冷戦」の最前線は東南アジアに 米中のAI覇権争いが地政学リスクを加速英誌『エコノミスト』は7月30日、中国がすでに米国に匹敵するAIモデルを構築したものの、高性能チップの不足により大規模な実用化が依然として困難であると指摘した。業界が行き詰まり、代替策を模索する中、トランプ政権は7月に突如としてエヌビディアの対中輸出禁止を緩和し、中国のAI発展に転機が訪れた。同時に、地理的優位と中立的立場を背景に、東南アジアはAIデータセン......

戦後80年──米軍記録映像が語る知られざる「戦争の実像」 映像解析で次世代へ記憶をつなぐ戦後80年、FPCJブリーフィングで航空戦史研究家・織田祐輔氏が講演公益財団法人フォーリンプレスセンター(FPCJ)は7月24日、航空戦史研究家の織田祐輔氏を招き、「戦後80年──米軍撮影の映像記録から解き明かす戦争の実像」をテーマにブリーフィングを開催した。米軍機に搭載されたガンカメラなどの実戦映像を解析することで、従来の史料では見えにくかった戦争の断面を......

堺が見せる日本の底力!大阪万博で職人技と伝統文化を再発見7月28日、大阪・関西万博「大阪ヘルスケアパビリオン」にて/伝統工芸や相撲体験など多彩なプログラムを展開2025年7月28日、堺市は大阪・関西万博の「大阪ヘルスケアパビリオン -reborn stage-」にて、「Re-Discover JAPAN’s Beauty in Sakai, Osaka(堺で再発見する日本の美)」と題した文化体験イベントを開催する......

暑さに負けない!梅・ネギ・XO醤…五味で味わう“夏ごはん” アコメヤのフェアが全国で開催中五感で味わうごはんのお供、全国の店舗とオンラインで展開株式会社AKOMEYA TOKYO(東京都渋谷区、代表取締役社長:山本浩丈)は、2025年7月25日(金)から8月28日(木)まで、「夏の五味フェア」を開催する。期間中は「酸味」「香味」「旨味」「塩味」「辛味」という5つの味覚に焦点を当てた、夏にぴったりの“ごはんのお供”が全国の店舗と公式オンラインショッ......

暑さにひと息!茅乃舎の「冷たい飲むだし」東京&福岡で無料提供、先着100名限定茅乃舎が東京・福岡で“給水スポット”を期間限定オープン連日の猛暑が続くなか、だしの老舗ブランド「茅乃舎(かやのや)」を展開する久原本家グループは、夏の水分補給をサポートする新たな取り組みとして、“冷たい飲むだし”が体験できる「給水スポット」を店舗内に初設置する。対象となるのは、「茅乃舎 東京駅店(グランスタ丸の内)」と「久原本家 ららぽーと福岡店」の2店舗。......

猛暑を忘れる没入体験 チームラボで境界のないアートと涼感スイーツを楽しもう森ビル株式会社がアートコレクティブ・チームラボと手がける「森ビルデジタルアートミュージアム:エプソンチームラボボーダレス」は、麻布台ヒルズにある。麻布台ヒルズは日比谷線神谷町駅5番出口から直結のため、直射日光に当たることなく建物の中へ入ることができ、猛暑が続く夏の外出先としておすすめだ。ミュージアムでは、チームラボによる没入型のアート作品とともに、館内のティ......

「石破首相は辞任すべき」自民党内で退陣論が噴出 ヒゲの隊長も決断迫る参議院選挙で歴史的な敗北を喫したことを受け、自民党内で石破茂首相に対する退陣要求が急速に高まっている。7月28日に行われた両院議員懇談会では、落選議員を含む多数の議員が執行部の責任を追及し、党内の危機感が一気に噴出した。懇談会には236人が出席し、64人が発言。比例代表で落選した佐藤正久参院議員(通称「ヒゲの隊長」)は、会合前にテレビ番組で「トップは結果責任......

イチロー、アジア人初の米野球殿堂入り 「3度目の新人」とユーモア溢れるスピーチアジアで初めてアメリカ野球殿堂入りした伝説のプレイヤー・イチロー(鈴木一朗)が現地時間7月27日、クーパーズタウンで表彰式に出席した。彼はシアトル・マリナーズなどで活躍し、通算3089安打を記録した日本の野球の巨星であり、19分間の英語のスピーチで、自身の心の旅路を振り返った。三度目の「新人」一朗は演説の冒頭で、自身をおどけて紹介し、観衆との距離を縮めた。彼......

韓国が15%関税優遇と引き換えに差し出したものとは?台湾が驚く「代償の大きさ」アメリカのトランプ大統領は、自身のSNS「Truth Social」で重大な合意を発表した。米韓が包括的な貿易協定に達し、韓国が15%の優遇関税率を享受することが決まったという。この税率は、日本や欧州連合(EU)といった米国の親密な同盟国と同水準である。注目されるのは、トランプ氏によれば、韓国はこの関税優遇を得るため、米国に対して3500億ドル(約10兆40......

評論:なぜリコールは失速したのか 強権的な拘束と「司法不信」が招いた反発7月26日の大規模リコールは全敗に終わり、民進党陣営からは様々な分析が飛び交っている。「現金1万元の普及配布で台湾を買収した」「国民党の地盤を攻めても基本票には勝てない」「中間層の有権者が動かなかった」「『抗中保台』の効力が低下している」など、多種多様である。中には滑稽なものや的外れなものもあるが、民進党が意図的に目をそらしている一点がある。「民進党嫌い」と......

北京観察》中国社会は台湾の「大リコール」に強い関心 学者「北京は国民党にまだ期待?」中国国務院台湾事務弁公室(国台弁)の陳斌華報道官は、大規模リコール投票の結果を受けた記者会見で今後の両岸関係について「その『台独』の禍心を見極め、決して共鳴しない」と発言した。一方で、中国の民間世論は民進党の今後の政権運営の行方に異例の関心を寄せ、特に卓榮泰行政院長(台湾の首相に相当)率いる行政チームがどのような結末を迎えるのかを注視している。取材に応じた学......

頼清徳総統、リコール惨敗で支持者に謝罪 「悔しさを改革の決意に変える」台湾・民進党は本日(30日)、常任中央執行委員会を開催した。会議後、民進党の報道官である韓瑩氏が会見で伝えたところによると、党主席の頼清徳氏は、リコール投票の結果について「多くの人々が落胆し、また深い無念を感じています」と述べた。民進党に至らなかった点があったことを認め、「すべての批判を受け止めるとともに、この運動に関わってくださった市民団体および支持者の皆......

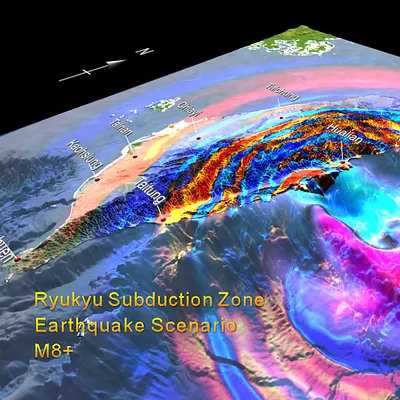

津波警報で交通網まひ 東海道線、横須賀線など主要路線が終日運休、仙台空港も滑走路閉鎖ロシア・カムチャツカ半島沖で30日午前に発生したマグニチュード8.8の巨大地震により、日本の太平洋沿岸には津波警報・注意報が発表され、交通網に大きな影響が出ている。JR東日本は東海道線などの主要路線で終日運転を見合わせ、仙台空港でも滑走路が閉鎖されるなど、各地で混乱が続いている。30日午前、ロシア・カムチャツカ半島沖で発生したマグニチュード8.8の地震により......

舞台裏》日本と台湾の53年の禁忌を突破 林佳龍外交部長が東京都を訪問台湾全土を巻き込む大規模リコールの渦中、台湾の対日外交は静かに歴史的な一歩を踏み出していた。7月25日正午、外交部長の林佳龍氏は自身のフェイスブックでリコールに言及し、国内メディアからは「昼休みに政党活動をしているのでは」と批判され、行政中立法の境界線を踏んでいると指摘された。しかし、その投稿の時点で林氏は台北市の外交部本部にはおらず、飛行機で3時間以上離れ......

台海解読》米中首脳会談の陰で台湾は犠牲に? 賴政権に「厄介者」回避のブレーキ役米国のトランプ政権が中国との貿易交渉を本格化させる中、台湾問題は不可避に交渉の焦点となっている。台湾大学政治学部の左正東氏は『風傳媒』への分析で、賴清徳総統の対中姿勢が強硬なため、政権内部で「軟化」シグナルを出す動きが見られると指摘した。副総統の蕭美琴氏が「現状維持」を強調し、海峡両岸事務局副主任委員の梁文傑氏も「台湾に中国人かどうかの問題はない」と発言。こ......

TSMCの苦境!インテル救済か25%関税か 専門家「短期利益も長期は不透明」世界の半導体業界はかつてない緊張感に包まれている。トランプ米大統領は再び関税を掲げ、今回の標的は台湾の半導体大手、TSMC(台積電)だ。業界関係者によると、トランプ政権は台湾製半導体に最大25%の懲罰的関税を課すことを検討しており、その背景にはTSMCがインテルの救済を拒んだことがあるという。政治とビジネスが絡むこの駆け引きは、両社の運命だけでなく、世界の半......

台湾が15%の最適関税を獲得の可能性 追加投資と米中交渉の駒リスク米ブルームバーグの29日の報道によれば、台湾の頼清徳総統が過去1週間に国内外で連続して打撃を受け、政権基盤や国際的存在感が大きく揺らいでいると報じた。米国による対台湾関税の決定期限は8月1日に迫るが、トランプ政権は具体的な数字を示していない。台湾側は日本と同様に15%の関税が適用される可能性を見込むが、米国は対等な関係を示すどころか、台湾に対米投資の大幅増を......

「関税交渉」期限迫る トランプ政権が台湾に「最良税率」提示か、中国は慎重対応アメリカとの対等関税交渉の期限が8月1日に迫る中、米ブルームバーグは関係者の話として、トランプ政権が台湾に「最良の関税率」を提示していると報じた。台湾の官員は、日本に適用された15%の税率が参考になるとの見方を示している。元立法委員の邱毅氏は30日、フェイスブックで米貿易交渉を分析し、トランプ氏は「唯一避けたい国は中国」であり、10月の訪中を控え、米中関係改......

舞台裏》高雄での民進党陣営初選の変化!「三分天下」が定局 彼女は最強勢力の支援を得た民進党の次期高雄市長選の党内予備選が激しさを増している。立法委員の林岱樺氏が補助金詐欺の疑いで起訴され、党の規則により資格停止の危機に直面する中、「退く意向」が浮上している。地元事情に詳しい関係者によれば、林岱樺氏と長年地盤を共有してきた許智傑氏が最も利益を得る可能性が高くなるという見方もある。新潮流派に属する許氏は党内で強い影響力を持ち、今回の選挙でも有力......

ゼレンスキー大統領の職務解除を検討か 米英がウクライナ高官と秘密会談と報道ロシア対外情報局の情報によると、米国と英国は最近アルプスで秘密会議を行い、ウクライナのゼレンスキー大統領の職務解除の可能性を話し合った。また、ウクライナ陸軍上将であり、通称「鉄将軍」と呼ばれるウクライナ駐英国大使ザルージニーを次期大統領に推薦することが検討された。ザルージニーはウクライナ武装部隊の上将であり、現ウクライナ駐英国大使である。過去にはウクライナ武......

独立派支持者も民進党に不満? 専門家「反罷免は藍白連携だけではない、第三勢力の怒りが鮮明に」7月26日に行われた台湾史上最大規模の「大リコール(罷免投票)」は、国民党(藍)所属の立法委員24人と職務停止中の高虹安・新竹市長の罷免がいずれも成立せず、民進党(緑)およびリコール推進団体にとって大きな打撃となった。台湾シンクタンク「台湾永続棧」の研究者・呉奕辰氏は自身のFacebookに投稿しで投票データを分析し、「反罷免」票の拡大は国民党支持層の動員力......

M8.8巨大地震、津波がロシア沿岸を直撃 史上最強地震と津波被害を振り返るロシア極東のカムチャツカ半島沖で30日午前(現地時間)、マグニチュード8.8の巨大地震が発生した。米国地質調査所(USGS)は当初の推定値を上方修正し、震央はペトロパブロフスク・カムチャツキーの南東約131キロ、震源の深さは126キロと発表した。この地震により赤色の「津波警報」が発令され、アラスカ沿岸、ハワイ諸島、日本の太平洋沿岸も警戒範囲に含まれている。ロ......

評論:「反中カード」が裏目に?頼清徳総統、孤立深める 米国も北京に配慮の姿勢泣きっ面に蜂の状況で、頼清徳総統は内外からの圧力にさらされている。大規模リコールで完敗した直後、中南米への外遊も途中で足止めされた。『フィナンシャル・タイムズ』が報じたところによれば、その原因は米国のトランプ大統領が中国の習近平国家主席との会談を優先し、頼氏のニューヨーク経由を拒否したことにあるという。トランプ氏は米中首脳会談のために北京に配慮し、台湾の利益......

トランプ政権が「黄金株」で拒否権 米国で国家資本主義モデルが加速か世界は現在、米中間の最新の関税交渉と、その力関係の行方に注目している。しかし、米国経済が直ちに危機に直面しているわけではない状況下で、トランプ政権は近年まれに見る大規模な企業介入に踏み切った。株式投資を通じた関与にとどまらず、企業の重要な経営判断にまで直接介入しており、その主な理由として「対中対抗」を掲げている。こうした動きは「市場介入」と「国家安全保障戦略......

解説》米国でも「大リコール」はできる?カギはシュワルツェネッガーにあり台湾史上初の「大リコール」投票は7月26日に幕を閉じ、結果は25対0となった。現職の立法委員や与党の県市長はいずれもリコールされず、与党・民進党と頼清徳総統にとっては大きな政治的打撃となった。一方で、野党の国民党や民衆党、多くの立法委員にとっては大きな励みとなった。多くの分析によれば、台湾の有権者は既存の民選代表や官員を肯定する傾向にあり、選挙結果を軽々しく......

TSMCがテスラの165億ドル契約を逃す!マスク氏が新チップ製造を「この企業」に依頼サムスンのウエハー製造事業は、長年にわたり歩留まりの低さなどの問題で批判を受けてきた。しかし、ここに来てついに突破口を開き、総額165億ドル(約2兆6,000億円)に達する大型契約を獲得し、現在世界首位の「台湾護国神山」ことTSMCに反撃の一手を打った。報道によれば、契約を結んだ相手は米国の電気自動車大手テスラであり、イーロン・マスク最高経営責任者(CEO)......

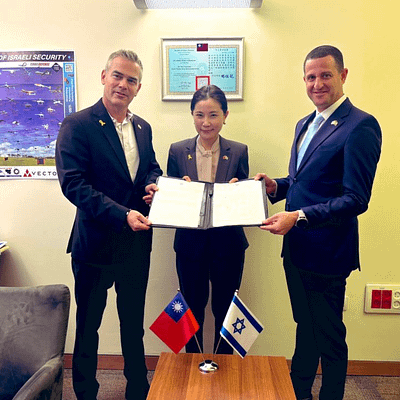

台湾が国際的非難の渦に直面 アムネスティ「ジェノサイド共犯」の可能性を警告イスラエルとパレスチナの戦闘が続く中、台湾政府がイスラエルに医療センター建設の資金提供を約束したとの情報が伝わった。問題となっている計画地は、イスラエルが占拠し入植を進めるパレスチナ領土、いわゆる入植地である。国際法は入植地建設の支援を明確に禁じており、今回の動きは2023年末以降、国家が入植地に直接資金を提供する初の事例となる。アムネスティ・インターナショ......